Miękki “choker” na szyję + AI, który zamienia ciche mikrodrgania mięśni krtani w mowę – w czasie < 1 sekundy, bez implantów.

Co zrobili badacze (Cambridge, Nature Communications 19.01.2026):

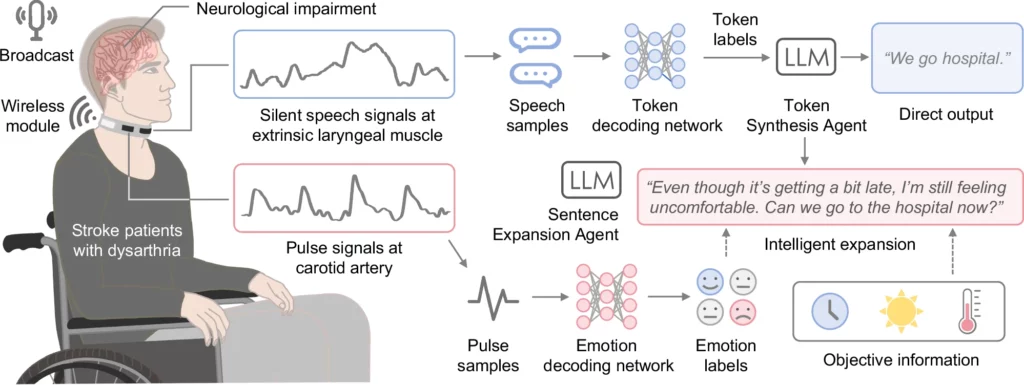

– czujniki tekstylne na szyi zbierają sygnał z mięśni + tętno (carotid/pulse)

– model dekoduje słowa, a opcjonalnie LLM “domyka” zdanie i poprawia płynność + ekspresję emocji

Wyniki (u pacjentów po udarze):

– word error rate ~4,2%, sentence error rate ~2,9%

– rozpoznawanie stanu emocjonalnego z sygnałów ~83%

– po włączeniu rozszerzania zdań przez AI: +55% satysfakcji pacjentów

Uczciwie o ograniczeniach:

Mała próba, krótka obserwacja, ograniczony słownik i język testów → to jeszcze nie jest gotowe “do poradni”.

Wniosek:

Miękki “choker” na szyję + AI, który zamienia ciche mikrodrgania mięśni krtani w mowę – w czasie < 1 sekundy, bez implantów.

Duże modele językowe przestają tu być chatbotem – stają się protezą języka. Jeśli z kilku subtelnych sygnałów z szyi potrafią przywrócić płynną komunikację, to następny krok to domowa, ciągła komunikacja i rehabilitacja mowy u pacjentów po udarze (i potencjalnie też w innych chorobach neurologicznych).

bfiałek